AI郵報

日本電商 ZOZO 用 AI 幫你配搭穿搭,但重要的是你的身體數據

ZOZO 正在把 AI 造型推薦、體型測量技術和時尚數據平台整合成一套全球化策略。 ZOZO 的 AI 個人化架構分為三層:AI 量體、AI 診斷、AI 推薦,並在 2026 年 4 月推出「ZOZO 的適合穿搭 AI Labo-kun」,透過 LINE 的對話式 AI,讓用戶用聊天的方式獲得每日穿搭建議。

WWDC26

Apple WWDC26 盛大登場,正式啟動 AI 大改造。本次發表會核心聚焦於 Apple Intelligence 的全面升級,並攜手 Google Gemini 重構 AI 架構。最大亮點為 Siri AI 的 15 年來最大進化,以及 iOS 27、macOS Golden Gate 等六大系統的全面 AI 化與效能提升。

OpenAI

一句話總結:Codex 是 OpenAI 推出的 AI 軟體工程代理,能自動完成寫程式、除錯、測試、重構等任務,讓開發者把時間花在真正重要的事上。

Apple

Apple 在 WWDC 2026 揭開序幕,背後隱藏著一場 2025 年初的高層秘密會議。這場會議不僅承認了 Apple Intelligence 的落後,更促成了與 Google Gemini 的合作,徹底重塑了 Siri 與蘋果的 AI 佈局。

日本一位沒有員工的稅務士,靠著 Claude Code 與自動化系統,成功服務 60 家客戶公司,打破傳統需要 6 名員工、年耗千萬日圓的人事常規。本文深度解析「AI First」的思維轉變——不再只是把 AI 當成卡關時的輔助工具,而是將工作設計成一套可自動運作的「公司系統」;並透過 Supervisor、Crew、Graph、Tool Use 四種 Agent 架構,解析如何打造高效率的企業級 AI 工作流。同時探討在多模型、多 Agent 常駐的趨勢下,如技嘉 AI TOP 500 TRX50 這類本地硬體基礎設施,如何成為 AI First 真正落地的關鍵。

看到喜歡的網站卻不知如何拆解?Aura.build 最新「URL 轉 DESIGN.md」功能,能一鍵抓取版型、字體與顏色。本文實測這個設計師專屬的 AI 工作流,解析優缺點與實戰避坑指南。

Adobe 與 Anthropic 合作推出「Adobe for creativity connector」,讓你在 Claude 對話框內直接調用 50 多個 Adobe 專業工具,包含 Photoshop、Premiere、Firefly、Lightroom 與 Express。本文完整說明安裝步驟、三大實用場景與兩個實作示範,讓你不用學軟體操作就能做出成品。

視覺生成進入「文字時代」!GPT-Image-2 不僅修復了色偏與亂碼,更透過推理能力實現角色一致性與精準 UI 生成。本文結合 LMSYS Arena 榜單數據與最新測試案例,為你分析這款「生產力級」AI 工具的商業潛力。

Anthropic 於 2026 年 4 月正式推出 Claude Design,讓沒有設計背景的人用一段文字就能生成 App 原型、簡報、Landing Page。本文從操作步驟、六大應用場景、Prompt 範例到費用方案,帶你完整掌握 Claude Design 的所有核心用法。

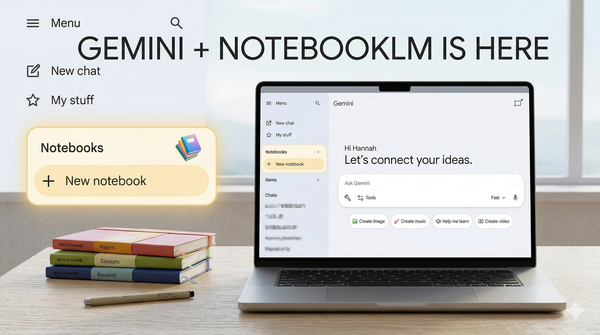

Google 推出 Gemini Notebooks,讓 Gemini 與 NotebookLM 的資料雙向同步。上傳一次文件,就能在 Gemini 做對話查詢,同時到 NotebookLM 生成影片、Infographic 與 Podcast 音檔。本文完整說明功能差異、操作流程,以及與 ChatGPT Projects 的比較。

Make Tech Fun. Make Knowledge Flow. Make AI for Everyone.

馬斯克旗下 SpaceX 正式遞交 S-1 申請,預計 2026 年 6 月 12 日以「SPCX」代號於那斯達克掛牌,目標估值高達 1.75 兆美元,有望成為人類史上最大 IPO。這不只是一場火箭公司的上市,更是 AI、太空資料中心、Starlink 衛星網路三大引擎的完美結合。以下深入解析 SpaceX IPO 的時間表、財務數字、太空 AI 布局,以及台灣供應鏈受益機會。

Suno 完成超過 4 億美元的 D 輪融資,投後估值達 54 億美元。uno 年度經常性收入已達 3 億美元,付費用戶突破 200 萬,並預告將在未來幾個月推出首個與音樂產業共同開發的 AI 模型。 Warner Music Group 已於去年 11 月與 Suno 達成和解並建立授權合作,Universal Music Group 和 Sony 截至目前仍與 Suno 處於積極訴訟中。

Alphabet 原計畫募資 400 億美元,因需求超額提高至 450 億,下季再發 400 億,總規模 850 億美元創歷史紀錄。這筆錢全數投入 AI 基礎設施,而公開市場買單的事實,正在改寫 AI 資本戰的規則。

Lovable 與 Google Cloud 宣布擴大多年合作,將 Google Cloud 用量放大 5 倍,整合 Gemini 模型、Wiz 安全工具與企業採購通路。AI coding 工具的競爭重心,正從模型回答品質轉向算力、安全治理與企業生態系整合。

HPE Q2 營收 107 億美元、年增 40%,Cloud & AI 部門利益率從 6.6% 跳升至 12.4%,全年財測大幅上調,公司宣布提前兩年達成長期目標。股價單日暴漲 28%,市場重新定價的不只是 HPE,而是整條 AI 基礎設施供應鏈。

LLM Wiki 是一種讓 AI 幫你整理、更新與維護知識庫的新玩法。本文從 OpenAI 創始成員 Andrej Karpathy 的概念出發,解析 LLM Wiki 是什麼、和 RAG 有什麼不同,以及如何用它打造會累積知識的第二大腦。

Microsoft 推出首個 Autopilot agent——Scout,整合 Teams、Outlook、OneDrive、SharePoint,可在背景持續追蹤工作脈絡、主動安排會議、標記風險、推進任務。每個 agent 操作都綁定 Entra 企業身份,可追蹤、可審計,目前開放 Frontier 組織私測。

如果問你, 2026 年針對台北知名的行銷案例是什麼?我想多數人的答案會是 Alex Honnold 攀登 101。但如果這是一道多選題,GTC Taipei 必定會出現在熱門答案裡,而且經濟效益更難被忽略 XD。 去年,NVIDIA 將 GTC 移師台北、落腳漢來大飯店兩天,就已在業界掀起軒然大波。今年的規模更是升了好幾個量級。去年 30 場議程、兩天會期,今年擴張到 50 場以上的演講、70 場以上的實作訓練,橫跨台北國際會議中心 、漢來大飯店以及二館的 NVIDIA Inception 專區,展區間的來往已經需要專程巴士接送了。 Computex 也是一樣,今年 Computex 是創辦 46 年來規模最大的一屆,集結 1,500 家參展商、來自 33

Uber 對員工使用 Claude Code、Cursor 等 AI coding tools 設定每人每月 1,500 美元上限,起因是公司在 2026 年前 4 個月就燒完全年 AI 預算。這不是單一公司的預算插曲,而是企業 AI 從「導入率競賽」進入「ROI 驗證期」的第一個明確訊號。

美國佛州司法長正式起訴 OpenAI 與 Sam Altman,指控公司在向大眾推廣 ChatGPT 時隱瞞安全風險,是全美第一起州政府主導、直接針對 AI 公司與其 CEO 的訴訟。這起案件把產品責任、未成年人保護與企業高層個人責任,一次推到司法前線。

Anthropic 已向美國 SEC 正式提交 S-1 草稿,正式啟動 IPO 前置程序。這份文件本身不代表確定上市,而是給 Anthropic 在 SEC 審查完成後進入公開市場的選項。提交時機緊接估值 9,650 億美元的 650 億美元 Series H,讓 AI 模型公司能否撐起近兆估值的問題,第一次將被公開市場檢驗。

NVIDIA 在台北 GTC 暨 Computex 2026 大會上,正式發布 Cosmos 3——全球第一個完全開放的 Physical AI 全模態基礎模型(Omnimodel)。 這是機器人與自駕車領域的重大里程碑,單一模型即可同時處理視覺推理、世界生成與動作預測三大任務。